Il y a généralement une augmentation de désinformation pendant la période électorale en raison des efforts visant à inciter les gens à voter pour ou contre différents candidats ou causes. Avec l’émergence de IA générativecréer ce type de contenu est plus facile que jamais et les gens partagent leurs inquiétudes quant à l’impact que cette tactique peut avoir sur l’intégrité des élections.

Jeudi, Adobe a publié sa première étude sur l’avenir de la confiance, qui a interrogé 2 000 consommateurs américains sur leurs expériences et leurs préoccupations concernant la désinformation, en particulier avec l’émergence de l’IA générative.

Aussi: Les meilleurs générateurs d’images IA de 2024 : testés et examinés

Jusqu’à 84 % des personnes interrogées se disent préoccupées par le risque que le contenu qu’elles consomment en ligne soit modifié pour diffuser des informations erronées, et 70 % déclarent qu’il est de plus en plus difficile de vérifier si le contenu qu’elles consomment est digne de confiance.

En outre, 80 % des personnes interrogées ont déclaré que la désinformation et les deepfakes nuisibles auront un impact sur les élections à venir, et 83 % d’entre elles appellent les gouvernements et les entreprises technologiques à travailler ensemble pour protéger les élections de l’influence du contenu généré par l’IA.

Alors, à l’ère de l’IA, comment se préparer aux prochaines élections ?

La bonne nouvelle est que certaines entreprises travaillent déjà sur des outils, tels que Informations d’identification du contenu, pour aider les gens à déchiffrer entre le contenu généré par l’IA et la réalité. Pour vous aider à naviguer au mieux dans la prochaine saison électorale, ZDNET propose quelques conseils, astuces et outils.

1. Regardez tout avec scepticisme

La première et la plus importante chose à retenir est de tout considérer avec scepticisme. La capacité de créer des deepfakes convaincants est désormais accessible à tous, quelle que soit l’expertise technique, avec des ressources gratuites ou modèles d’IA génératifs peu coûteux facilement disponible.

Ces modèles peuvent générer du faux contenu pratiquement impossible à distinguer du contenu réel sur différents supports, notamment le texte, les images, la voix, la vidéo, etc. Il ne suffit donc plus de voir ou d’entendre quelque chose pour y croire.

Un bon exemple est le faux appel automatisé récent du président Joe Biden qui a encouragé les électeurs à ne pas se présenter aux urnes. Cet appel a été généré à l’aide de l’outil ElevenLabs Voice Cloning, facile d’accès et d’utilisation. Vous n’avez besoin que d’un compte ElevenLabs, de quelques minutes d’échantillons vocaux et d’une invite texte.

Aussi: Microsoft révèle son intention de protéger les élections contre les deepfakes

La meilleure façon de vous protéger est d’examiner le contenu et de confirmer si ce que vous voyez est réel. J’inclus quelques outils et sites ci-dessous pour vous aider à le faire.

2. Vérifiez la source de l’actualité

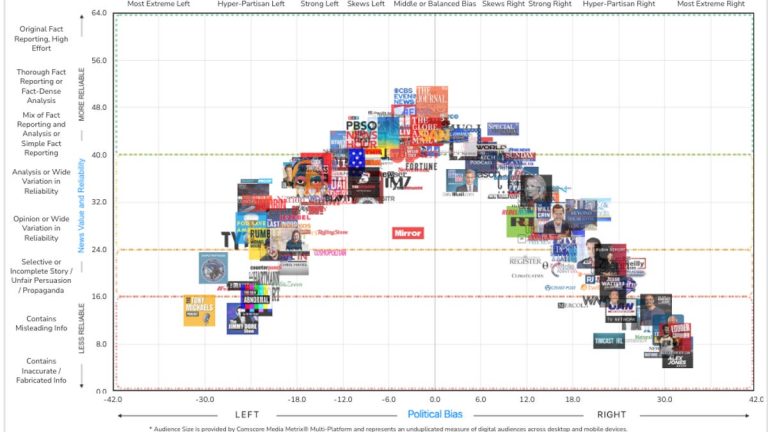

Si vous rencontrez du contenu sur un site que vous ne connaissez pas, vous devez vérifier sa légitimité. Il existe des outils en ligne pour vous aider à le faire, notamment le Tableau des biais des médias interactifs Ad Fontes Mediaqui évalue les préjugés politiques, la valeur médiatique et la fiabilité des sites Web, des podcasts, des émissions de radio et bien plus encore, comme le montre le tableau ci-dessous.

Si le contenu que vous rencontrez provient des réseaux sociaux, soyez extrêmement prudent car, sur la plupart des plateformes, les utilisateurs peuvent publier ce qu’ils veulent avec un minimum de contrôles et de limitations. Dans ces cas-là, c’est une bonne pratique de croiser le contenu avec une source d’information réputée. Vous pouvez utiliser un outil, comme celui ci-dessus, pour trouver une source d’information qui mérite d’être référencée.

3. Utilisez les informations d’identification de contenu pour vérifier les images

Les informations d’identification de contenu agissent comme une « étiquette nutritionnelle » pour le contenu numérique, ajoutant en permanence des informations importantes, telles que la personne qui a créé les images et les modifications apportées via des métadonnées cryptographiques et des filigranes. De nombreux générateurs d’images IA, tels que Adobe Lucioleincluent automatiquement les informations d’identification de contenu qui indiquent que le contenu a été généré à l’aide de l’IA.

« Conscient de l’utilisation abusive potentielle de l’IA générative et de la manipulation trompeuse des médias, Adobe a co-fondé la Content Authenticity Initiative en 2019 pour contribuer à accroître la confiance et la transparence en ligne grâce aux informations d’identification de contenu », a déclaré Andy Parsons, directeur principal de la Content Authenticity Initiative chez Adobe.

L’affichage des informations d’identification du contenu d’une image est un excellent moyen de vérifier comment elle a été créée, et vous pouvez voir ces informations en accédant au Site Web d’informations d’identification du contenu pour « inspecter » l’image. Si l’image ne contient pas les informations dans ses métadonnées, le site Web fera correspondre votre image à des images similaires sur Internet. Le site vous indiquera alors si ces images ont été générées par l’IA ou non.

Vous pouvez également inverser la recherche d’images sur Google en déposant l’image dans la recherche Google du navigateur et en recherchant les résultats. Voir où l’image est apparue peut vous aider à déterminer sa date de création, la source et si l’image est apparue sur des points de vente réputés.